Was wir tun

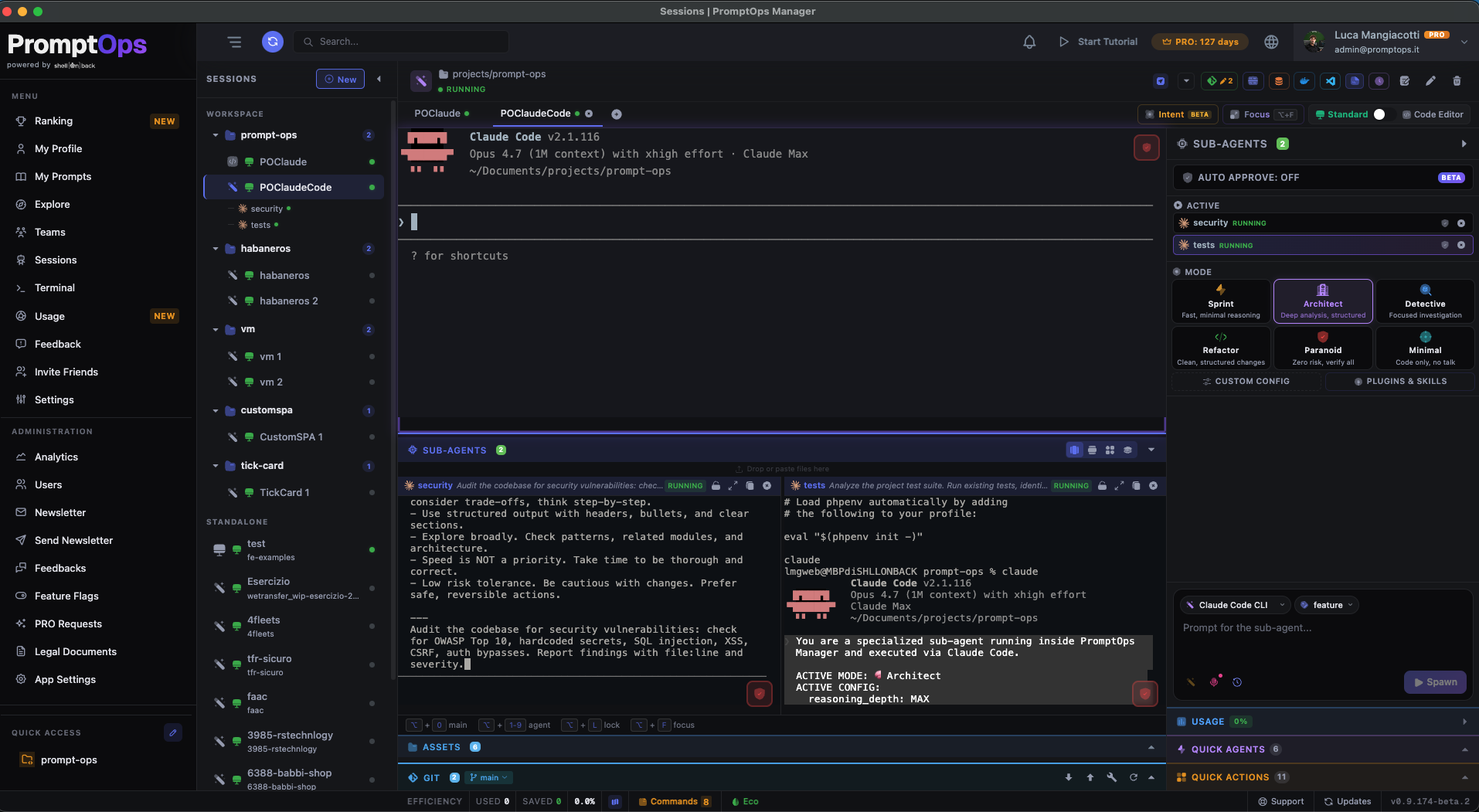

Wir bringen PromptOps in dein Unternehmen — von der Discovery bis zur Produktionsautomatisierung.

Discovery & Audit

Wir analysieren deine operativen Prozesse, um die automatisierbaren Aufgaben mit dem höchsten ROI zu identifizieren.

Design & Implementierung

Wir gestalten vollständige AI-Workflows: strukturierte Prompts, Verarbeitungsketten, Output-Validierung.

Kontinuierliche Optimierung

Wir überwachen die Performance, verfeinern Prompts und skalieren Workflows.

Compliance & Security

DSGVO-konform, verschlüsselte Daten, vollständiger Audit Trail. Individuelle NDAs und SLAs.

Echte Anwendungsfälle

PromptOps-Workflows, die heute in Unternehmen funktionieren.

Automatisches E-Mail-Triage

200+ E-Mails/Tag klassifiziert, Daten extrahiert und CRM-Tickets automatisch erstellt.

Periodische Berichtsgenerierung

Wöchentliche Berichte aus Daten von 5 verschiedenen Systemen generiert. Validierter und formatierter Output.

Intelligente Dateneingabe

Datenextraktion aus PDFs, Rechnungen und unstrukturierten Dokumenten. Automatisches Befüllen mit Validierung.

Content-Qualitätskontrolle

Automatisiertes Review von Texten, Übersetzungen und technischer Dokumentation.

Was ist ein Prompt in der AI

Definition

Ein prompt ist eine Textanweisung, die an ein Sprachmodell (LLM) gesendet wird, um einen bestimmten Output zu erhalten. Es ist das Interface zwischen dem Nutzer und der künstlichen Intelligenz.

Es kann eine einfache Frage sein, eine komplexe Anweisung mit Kontext, Constraints und erforderlichem Format, oder ein wiederverwendbares Template mit dynamischen Variablen.

Der prompt ist keine Wegwerfnachricht: Er ist die fundamentale operative Einheit jedes AI-basierten Workflows.

Prompt-Typen

Zero-shot-Prompts (ohne Beispiele), few-shot (mit Beispielen), chain-of-thought (schrittweises Reasoning), System-Prompts (persistente Kontextanweisungen).

In PromptOps sind Prompts strukturiert, versioniert und für spezifische Aufgaben optimiert — nicht ad-hoc geschrieben.

Der prompt als operatives Interface

In Geschäftsabläufen wird der prompt zu einem strukturierten Interface: Projektkontext, technische Constraints, erwarteter Output, erforderliches Format.

Den prompt als versioniertes und geteiltes Asset zu behandeln, ist der erste Schritt in Richtung PromptOps.

Was sind PromptOps

Formale Definition

PromptOps (Prompt Operations) ist die operative Disziplin, die repetitive Geschäftsprozesse in automatisierte, skalierbare und kontrollierte Workflows umwandelt, die von künstlicher Intelligenz betrieben werden.

Es kombiniert strukturiertes prompt-Design, Sprachmodell-Orchestrierung und End-to-End-Workflow-Management — von der Eingabe bis zur Output-Validierung.

In der Praxis, für Unternehmen

PromptOps verwandelt Aufgaben, die derzeit stundenlange manuelle Arbeit erfordern — E-Mail-Klassifizierung, Dateneingabe, Berichtsgenerierung — in automatisierte Workflows mit minimalem Aufwand.

Es geht nicht darum, "ChatGPT zu nutzen": Es geht darum, zuverlässige, messbare und skalierbare Prozesse rund um AI aufzubauen.

PromptOps vs. ähnliche Konzepte

PromptOps vs. Prompt Engineering

Prompt Engineering ist eine technische Fähigkeit: effektive Prompts schreiben. PromptOps ist eine breitere operative Disziplin, die Prompt Engineering einschließt, aber Orchestrierung, Validierung, Integration und kontinuierliche Iteration hinzufügt.

Prompt Engineering ist ein Werkzeug; PromptOps ist das System.

PromptOps vs. Traditionelle Automatisierung

Traditionelle Automatisierung (RPA, Skripte) folgt starren Regeln. PromptOps nutzt Sprachmodelle, um variable, unstrukturierte und mehrdeutige Eingaben zu verarbeiten — wo feste Regeln versagen.

PromptOps vs. LLMOps

LLMOps befasst sich mit Infrastruktur und Modell-Lebenszyklus (Training, Deploy, Monitoring). PromptOps befasst sich mit operativen Workflows, die diese Modelle nutzen, um Geschäftsaufgaben zu erledigen.

| Aspekt | Prompt Engineering | PromptOps | LLMOps | AIOps |

|---|---|---|---|---|

| Fokus | Effektive Prompts schreiben | End-to-End AI-Betriebs-Workflows | Modell-Infrastruktur und Lebenszyklus | IT-Management mit AI |

| Umfang | Einzelner prompt oder Chain | Vollständiger Geschäftsprozess | Modell-Training, Deploy, Monitoring | Infrastruktur-Monitoring |

| Output | Optimierter prompt | Erledigte Geschäftsaufgabe | Deploydes und laufendes Modell | Alerts und automatische Remediation |

| Wer nutzt es | AI-Engineer, Researcher | Operations-Team, Back-Office | ML-Engineer, Data Scientist | SRE, DevOps-Engineer |

| Automatisierung | Partiell (einzelne Interaktion) | Vollständig (Eingabe → validierter Output) | Training/Deploy-Pipeline | Automatische Incident-Response |

Die Prinzipien von PromptOps

Jeder PromptOps-Workflow basiert auf diesen fundamentalen Prinzipien:

- 1. Operations first

- PromptOps existieren, um echte Aufgaben zu erledigen, nicht um mit Technologie zu experimentieren. Jeder Workflow muss einen konkreten, nutzbaren Output liefern.

- 2. Prozess, kein Zufall

- Jeder PromptOps-Workflow folgt einer definierten Struktur: Eingabe, Verarbeitung, Validierung, Output. Kein Ergebnis wird dem Zufall überlassen.

- 3. Messbarkeit

- Jede Operation muss klare Metriken haben: eingesparte Zeit, Output-Genauigkeit, Durchsatz, Kosten pro Aufgabe.

- 4. Kontinuierliche Iteration

- PromptOps-Workflows verbessern sich durch Feedback-Zyklen auf Basis echter Daten.

- 5. Menschliche Kontrolle

- AI führt aus, das Team validiert. PromptOps beinhalten immer menschliche Kontrollpunkte.

- 6. Skalierbarkeit

- Ein Workflow, der bei 10 Aufgaben funktioniert, muss bei 10.000 funktionieren. Designed für Volumen und Grenzkosten.

- 7. Integration

- PromptOps integrieren sich in bestehende Systeme — CRM, E-Mail, ERP — ohne sie zu ersetzen.

Wie PromptOps funktionieren

Der operative Zyklus

Jeder PromptOps-Workflow folgt einem strukturierten Zyklus:

- Eingabe: Rohdaten aus dem Trigger (E-Mail, Datei, Ereignis, Nutzeranfrage)

- Verarbeitung: Der strukturierte prompt wird mit dem notwendigen Kontext an das Modell gesendet

- Validierung: Der Output wird anhand vordefinierter Kriterien geprüft

- Lieferung: Der validierte Output wird an das Zielsystem geliefert

Workflow-Komponenten

- Trigger: Ereignis, das den Workflow startet (eingehende E-Mail, Datei-Upload, Zeitplan)

- Parser: Extrahiert und strukturiert die Eingabedaten

- Template: Strukturierter prompt mit dynamischen Variablen

- LLM Call: Sendet an das Modell und empfängt den Output

- Validator: Prüft Output-Qualität und Format

- Fallback: Fehlerbehandlung und Edge Cases

- Delivery: Liefert den Output an das Zielsystem

- Logger: Trackt jede Operation für Audit und Optimierung

Wie wir arbeiten

Vom ersten Kontakt zum Produktions-Workflow in Wochen, nicht Monaten.

Discovery Call

Erzähl uns von deinen Prozessen. Wir identifizieren die Quick Wins.

Technisches Audit

Wir kartieren Daten, Flows und Integrationen.

Implementierung

Wir konfigurieren Workflows, Prompts und Automatisierungen.

Go-live & Support

Produktions-Deploy mit kontinuierlichem Monitoring.

Häufig gestellte Fragen zu PromptOps

Antworten auf die häufigsten Fragen zu PromptOps, AI-Automatisierung und Business-Implementierung.

Was sind PromptOps?

PromptOps (Prompt Operations) ist eine operative Disziplin, die strukturiertes prompt-Design, Geschäftsprozessautomatisierung und End-to-End-Management von Workflows kombiniert, die von Large Language Models (LLMs) betrieben werden. Das Ziel ist, repetitive Aufgaben in automatisierte, skalierbare und kontrollierte Abläufe zu transformieren.

Was ist der Unterschied zwischen PromptOps und Prompt Engineering?

Prompt Engineering ist eine technische Fähigkeit, die sich auf das Schreiben effektiver Prompts konzentriert. PromptOps ist eine breitere operative Disziplin, die Prompt Engineering einschließt, aber Workflow-Orchestrierung, Output-Validierung, Integration mit Geschäftssystemen und kontinuierliche Iteration hinzufügt. Prompt Engineering ist ein Werkzeug; PromptOps ist das System.

Was kostet die Implementierung von PromptOps in meinem Unternehmen?

Das hängt von der Prozesskomplexität und dem Volumen ab. Wir bieten einen kostenlosen Discovery Call an, um deine Bedürfnisse zu analysieren, und einen transparenten Vorschlag mit Kosten und Zeitplan. In vielen Fällen ist der ROI innerhalb der ersten Wochen messbar.

Brauche ich technische Kenntnisse, um PromptOps zu implementieren?

Nicht, wenn du mit uns arbeitest. Wir verwalten den gesamten technischen Stack: von prompt-Design bis zur Integration mit deinen Systemen. Dein Team muss nur die Geschäftsanforderungen definieren und Outputs validieren.

Ersetzen PromptOps Mitarbeiter?

Nein. PromptOps automatisieren repetitive, wertarme Aufgaben und setzen Zeit für Tätigkeiten frei, die Urteilsvermögen, Kreativität und Beziehungen erfordern. Das Modell ist Augmentation, nicht Ersatz.

Welche Geschäftsaufgaben lassen sich mit PromptOps automatisieren?

Dokument- und E-Mail-Klassifizierung, strukturierte Content-Generierung, Datenextraktion aus PDFs und Tabellen, periodische Berichtserstellung, intelligente Dateneingabe, Text-Qualitätskontrolle und viele weitere repetitive operative Aufgaben.

Funktionieren PromptOps nur mit ChatGPT oder OpenAI?

Nein. PromptOps sind modell-agnostisch. Sie funktionieren mit jedem LLM: OpenAI GPT, Anthropic Claude, Google Gemini, Meta Llama, Mistral und Open-Source-Modellen. Die Modellwahl hängt von der Aufgabe, den Datenschutzanforderungen und dem Kosten-Leistungs-Verhältnis ab.

Wie misst man den Erfolg von PromptOps?

Die Hauptmetriken sind: eingesparte Zeit pro Aufgabe, Output-Genauigkeit (gemessen an validierten Stichproben), Durchsatz (erledigte Aufgaben pro Zeiteinheit), Kosten pro automatisierter Aufgabe und Rate menschlicher Eingriffe.

Sind PromptOps sicher für sensible Unternehmensdaten?

Mit den richtigen Richtlinien ja. Best Practices umfassen: Geheimhaltungsvereinbarungen (NDAs), DSGVO-Konformität, dedizierte oder On-Premise-Hosting-Optionen, Verschlüsselung von Daten im Transit und im Ruhezustand sowie vollständige Audit Trails für jede Operation.

Wie lange dauert es, bis der erste operative Workflow bereit ist?

Das hängt von der Komplexität ab, aber für Standard-Workflows (E-Mail-Klassifizierung, Datenextraktion, Reports) sind wir typischerweise 2-4 Wochen nach Vertragsunterzeichnung produktionsbereit. Der erste funktionierende Prototyp kommt oft innerhalb von 48 Stunden nach dem Discovery Call.